Yapay Zekâ Tarafsız mı? Görünmeyen Önyargılar ve Dijital Dünyanın Kör Noktaları

Yapay zeka kendinden çoğu zaman kendinden emin konuşurken aslında koca bir boşluğa konuşuyor. Çoğu zaman “nesnel” ve “tarafsız” gibi görünen dili oldukça yanlı ve önyargılarla dolu. Şimdi yapay zekalarla olan sohbetin arka yüzüne bakalım. Yapay zekâdaki yanlılık (AI bias) nedir, nasıl oluşur ve neden sandığımızdan daha büyük bir mesele? görelim.

Yapay zekâ yanlılığı (artificial intelligence bias), giderek daha fazla dikkat çeken yaygın ve ciddi bir sorundur. Bu kavram, yapay zekâ sistemleri tarafından üretilen adil olmayan ve önyargılı sonuçlar ya da tahminler ortaya çıkma olasılığına işaret eder; söz konusu sonuçlar önemli toplumsal ve bireysel sonuçlar doğurabilir. Aşağıda, literatürde sıklıkla atıf yapılan bazı yapay zekâ yanlılığı türleri özetlenmektedir.

Yapay zekâ modelleri verilerle eğitilir. Eğer o veriler:

- Eksikse

- Hatalıysa

- Belirli grupları yeterince temsil etmiyorsa

- Tarihsel önyargılar içeriyorsa

Ortaya çıkan model de doğal olarak sorunlu olacaktır.

Örneğin, sağlık alanında geliştirilen bir sistem çoğunlukla belirli bir demografiden gelen verilerle eğitildiyse, diğer gruplar için daha düşük doğrulukla çalışabilir. Sistem kötü niyetli değildir. Ama beslendiği veri çarpıktır.

Yani çarpık veri = çarpık sonuç.

Aşama 02: Algoritmik yanlılık: kod tarafsız ama karar süreci değil

Bazen sorun veride değil, algoritmanın tasarımında olur.

- Hangi değişkenler seçildi?

- Model nasıl optimize edildi?

- Performans hangi metrikle ölçüldü?

Yanlış özellik seçimi ya da eksik tasarım, belirli gruplara karşı sistematik dezavantaj oluşturabilir. Özellikle işe alım, kredi değerlendirme gibi alanlarda bu çok kritik.

Algoritma matematiksel olabilir ama onu tasarlayan insan.

Aşama 03: Kullanıcıdan öğrenen sistemlerin riski

Bazı yapay zekâ sistemleri kullanıcı davranışlarından öğrenir. Özellikle sosyal medya algoritmaları buna güzel bir örnek.

Eğer kullanıcılar:

- Aşırı görüşlere daha çok tepki veriyorsa

- Sansasyonel içeriklere daha fazla tıklıyorsa

Algoritma da bu içerikleri daha çok göstermeye başlar.

Sonuç?

- Daha fazla kutuplaşma

- Daha fazla yanlış bilgi

- Daha fazla yankı odası

Yapay zekâ sadece kullanıcıyı takip eder. Ama bu takip bazen toplumsal etkileri büyütebilir.

Aşama 04: Etkiletleme yanlılığı: İnsan faktörü devreye girince

Makine öğrenmesi sistemlerinde veriler genellikle insanlar tarafından etiketlenir.

Örneğin:

- “Bu yorum saldırgan mı?”

- “Bu fotoğraftaki kişi hangi kategoride?”

Bu süreçte etiketleyen kişi farkında olmadan kendi önyargılarını veri setine yansıtabilir.

Bu çok kritik çünkü model, “insanın süzgecinden geçmiş gerçeği” öğrenir.

Ve bu yanlılıkları temizlemek sanıldığı kadar kolay değildir.

Aşama 05: Değerlendirme yanlılığı: testte iyi, gerçek hayatta sorunlu

Bir sistem test ortamında adil görünebilir.

Ama gerçek dünyada aynı performansı göstermeyebilir.

Çünkü:

- Test verisi sınırlıdır.

- Gerçek hayat daha karmaşıktır.

- Kullanıcı davranışı değişkendir.

Bu nedenle sadece “accuracy” yüksek diye sistemin adil olduğunu varsayamayız.

Aşama 06: Dağıtım (Deployment) yanlılığı: sahaya çıkınca işler değişir

Model geliştirme sürecinde her şey yolunda olabilir.

Ama sistem gerçek kullanıcılarla buluştuğunda:

- Veri kalitesi değişir

- Kullanıcı alışkanlıkları farklılaşır

- Beklenmeyen senaryolar ortaya çıkar

Bu da performans kaymasına ve yeni tür yanlılıklara yol açabilir.

Yani model laboratuvarda iyi olabilir.

Ama sokakta başka davranabilir.

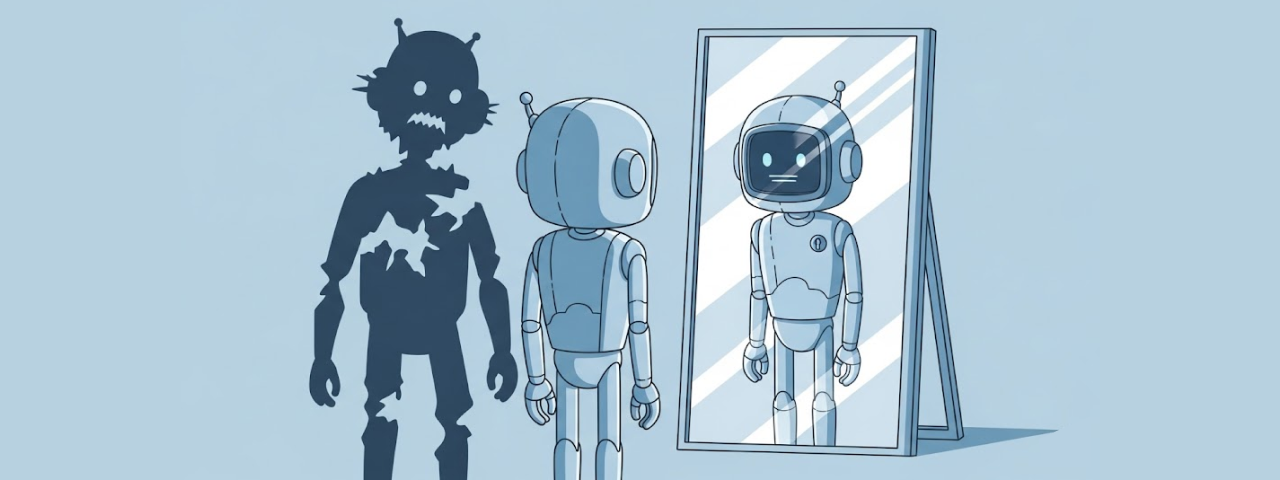

Sonuç olarak yapay zeka tarafsız değil, eğitilmiş bir aynadır

Yapay zekâ kendi başına iyi ya da kötü değildir. Geçirildiği sürece göre iyi veya kötü, adil veya problemli hale getirilebilir. Belki de en doğru bakış açısı şu olacaktır: yapay zeka geleceği şekillendirmiyor, bizim geçmişimizi yansıtıyor. Geçmişimizde ne varsa, ortaya o çıkıyor. Bu yüzden mesele sadece teknoloji değil;

Mesele tasarım, etik ve farkındalık.

Akademisyen, kullanıcı deneyimi ve arayüz tasarımı, veri görselleştirme, web/mobil uygulama geliştirme.

Kemal ŞAHİN'i yakından tanıyın.